AIPress.com.cn报道

OpenAI今日在Codex中发布了一项名为Chronicle的重磅实验功能。

这项功能赋予了AI助理“视觉”与“长期记忆”,让它能够通过实时感知你的屏幕内容,彻底终结那些繁琐的背景信息交代。

简单来说,就是让AI能看到你的屏幕。

它如何改变你的工作方式?

在过去,如果你想让AI帮忙debug或者处理文档,这往往需要耗费大量精力去解释:“我正在看哪个网页”、“报错信息是什么”、“我在和谁聊天”。

而现在,Chronicle充当了AI的眼睛。当你问“为什么这个会失败?”时,AI不再需要你复读,它会直接调取最近的屏幕截屏,它能发现你正在看GitHub Action报错日志,并直接给出解决方案。

这种能力的提升不仅仅体现在处理当下的问题。随着时间的推移,Chronicle会学习并记住工作习惯:你习惯在Word里写初稿,还是在飞书上和团队同步进度?

当你下达一个模糊指令,比如“同步最新草稿并通知小王”时,它能从海量记忆中精准锁定具体的文档版本和联系人,实现从“命令式”到“意图识别”的跨越。

Codex在上周刚推出了Memories功能,可以跨会话记住用户的偏好和项目。而Chronicle是Memories的扩展,靠后台进程定期截屏、做 OCR、分析你正在用哪些工具,再把这些信息整理成记忆文件。

背后的技术逻辑与门槛

Chronicle通过在后台运行沙盒化的智能体来处理屏幕截图,提取文字与视觉特征,并将其转化为本地存储的Markdown记忆文件。

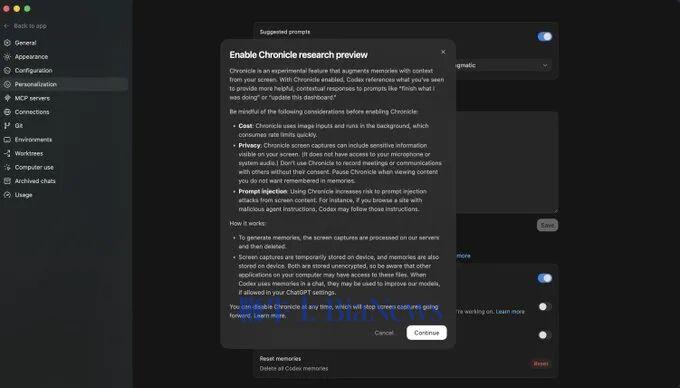

目前,该功能仅作为“研究预览版”向macOS平台的ChatGPT Pro用户开放,且需要授予系统级的“屏幕录制”与“辅助功能”权限。

由于涉及到极其严格的隐私政策,欧盟、英国及瑞士的用户暂时无法体验。

便利背后的代价

尽管它让AI变得更加灵活,但OpenAI官方也给出明确的警示:

1.算力消耗巨大: 由于涉及频繁的图像识别处理,Chronicle会极快地耗尽速率配额。

2.隐私边界挑战: AI会捕捉屏幕上的一切敏感信息。虽然截图在本地存储6小时后会自动删除,且OpenAI官方承诺不将这些数据用于模型训练,但未加密的本地Markdown记忆文件仍可能被电脑上的其他程序读取。

3.安全风险升级: 开启此功能后,提示词注入攻击的风险会显著增加。如果浏览了一个带有恶意指令的网页,AI可能会被这些视觉内容带节奏,进而执行非预期的操作。

同行的动作

事实上,AI读取屏幕这一方向不算新鲜。微软的Recall在Windows上实验了一年多,像Cursor这类热门IDE也在探索类似的上下文补齐技术。

然而,真正把这一逻辑做成一套持续运行的后台Agent,并且能够自动沉淀并更新长期记忆,再直接塞进一个命令行编程工具里,OpenAI的这种整合路径目前在业内尚属首创。

字节跳动前段时间开源了一个叫MineContext的项目,思路和Chronicle非常接近,同样基于屏幕截图和内容理解,能看懂用户的数字环境,并主动推送洞察、日周总结、待办和活动记录。

不同的是,MineContext不依附于某个开发工具,而是作为独立的主动式AI伙伴存在,未来还打算接入文档、视频、代码、外部应用数据等更多来源。它和computer use的关系也被不少人提到,本质上是同一类主动感知场景,只是切入点不同。

其实这本身有一个更普通的对应物,就是AI眼镜。

定时拍照、提取信息、帮助回溯物理世界里发生过的事,逻辑和Chronicle读屏是一样的,只不过一个盯着数字世界,一个盯着现实世界。

随着这类产品越来越多,“让AI持续感知你的环境并积累记忆”正在从一个概念变成一类具体产品。

然而,当AI需要24小时盯着用户的屏幕和生活时,隐私安全成为了最敏感的红线。

不少开发者直言,对于这种全天候监控的应用,只有走本地化和开源路线才能让人产生信任。这也正是最近凭借一条Launch Video走红的开源项目Omi备受推崇的原因。

Omi的口号是:“一个你比第一大脑更值得信任的第二大脑”。作为一个完全开源的项目,Omi能够实时捕捉并转录屏幕内容与对话,自动生成摘要和行动项。

无论是桌面端、手机端还是可穿戴设备,Omi都能无缝运行。其核心价值在于构建一个能够记住用户所有所见所闻的AI交互系统,同时将数据的掌控权彻底交还给用户。

Chronicle的截图处理后不留服务器、记忆文件存在本地,是OpenAI在隐私层面做出的让步。但和完全开源的方案相比,这中间仍然存在一道清晰的信任门槛。(转载自:AI普瑞斯)

扫码下载app 最新资讯实时掌握

扫码下载app 最新资讯实时掌握