3月16日消息,小米AI实验室研究员罗福莉,也就是很多人口中的“天才少女”,又发论文了。

论文名叫ARL-Tangram: Unleash the Resource Efficiency in Agentic Reinforcement Learning。作者之一,就是罗福莉。

如果只看标题,这篇论文似乎只是一个偏工程的研究:如何让AI Agent的强化学习训练更省算力。

但如果把它放在最近几个月AI的发展脉络里,

就会发现它其实正好落位在OpenClaw、Claude Code、Devin这一波 Agent浪潮的底层。

而要理解这篇论文所讲的东西,

需要我们先下一个定义,AI正在从“模型时代”进入“Agent时代”

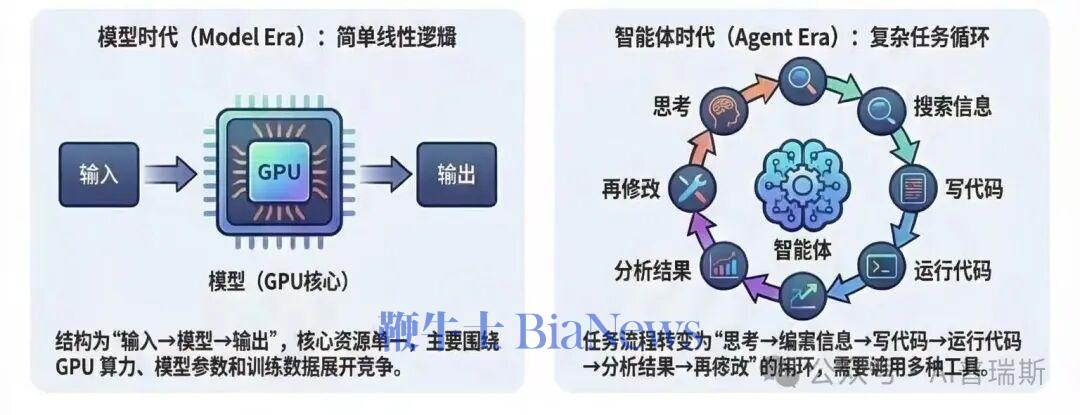

过去几年,大多数 AI 系统的结构其实非常简单。

输入一段内容,模型计算,然后输出结果。

从ChatGPT到图像生成模型,本质都是同一个逻辑:

输入→模型→输出

整个系统的核心资源也很单一,那就是GPU。

因此过去几年 AI 的竞争基本围绕模型参数规模、训练数据、GPU算力三件事来展开。

但随着AI Agent的出现,计算结构突然变得复杂起来。

一个典型的Agent任务可能是这样的:

思考→搜索信息→写代码→运行代码→分析结果→再修改

在这个过程中,AI不再只调用模型本身,还会不断调用各种工具。

要用GPU去做模型推理,要用CPU去执行代码,要用API去处理搜索、数据库,可能还要用浏览器进行网页操作......

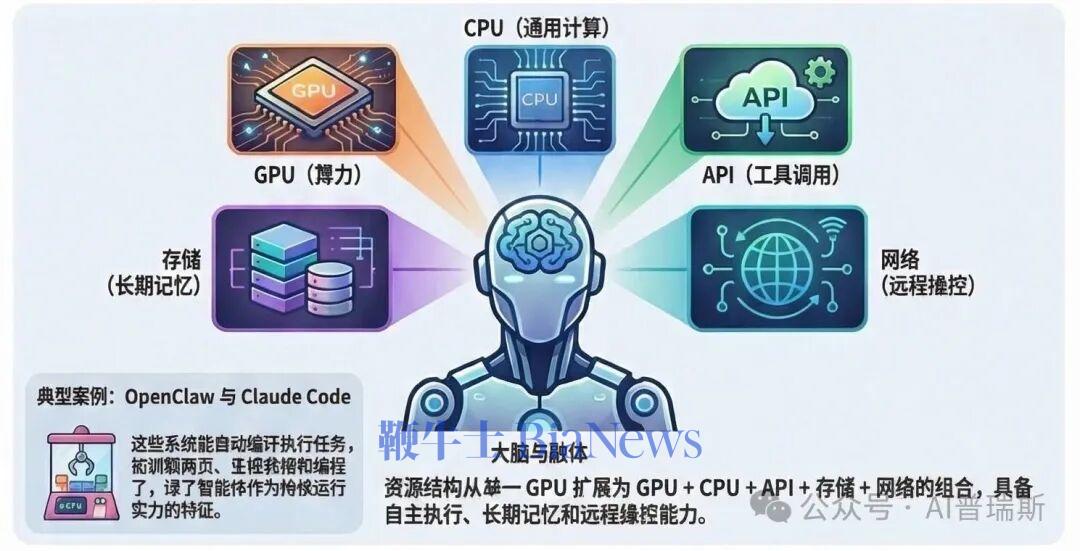

于是,一个Agent系统的资源结构就变成了:

GPU+CPU+API+存储+网络

这已经非常接近一个完整的软件系统。

“帮我整理今天的AI新闻并做成Excel。”

一个Agent就会搜索网页、抓取信息、总结内容、生成表格、保存文件,

整个过程涉及浏览器、Python、文件系统、模型推理。

这是Agent计算模式的典型例子,龙虾OpenClaw也是这么做的,

而最近Anthropic更新的Claude Code,也在逐渐向同样的方向发展。

/loop:让AI自动循环执行任务

CLAUDE.md:提供长期记忆

Session Spawning:手机远程启动电脑上的AI编程任务

连不少开发者看完更新后的第一反应都是“这不就是官方版龙虾吗?”

当远程操控、自主执行和长期记忆组合在一起时,AI不再只是一个聊天工具,而更像一个持续运行的数字员工。

好用,确实是好用,但真正的问题也就在其中,

算力怎么调度?

在传统模型训练中,资源基本只有GPU。

但在 Agent 系统里,不同任务会不断切换资源类型:

有时需要GPU,有时需要CPU,有时需要API

如果资源管理方式不合理,就会出现大量浪费。

论文里给出的典型例子中有一项数据,

在某些AI编程任务中,CPU的真实利用率只有47%。

剩下的算力基本处于闲置状态。

对于正在进行大规模训练的 AI 公司来说,这种浪费意味着巨大的成本。

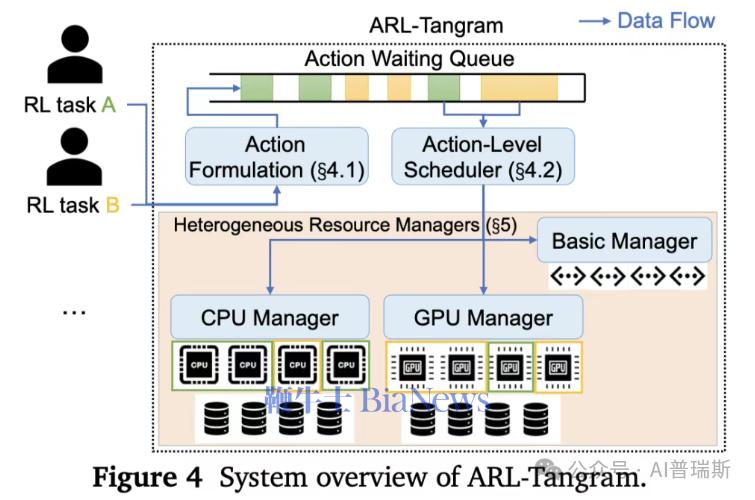

基于此,罗福莉等人的论文提出了一种新的系统:Tangram。

它的核心思路很像操作系统的进程调度。

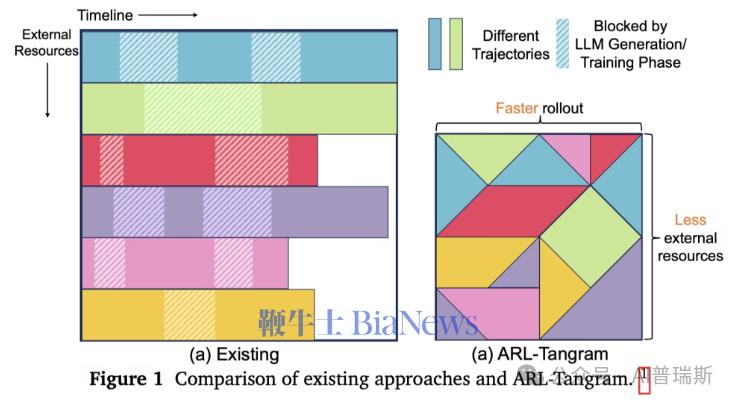

传统系统的资源分配方式是任务级调度:

一个Agent任务开始时,就会占用CPU或GPU,直到任务结束。

而Tangram采用的是动作级调度。

也就是说,只有当某个具体操作需要资源时,系统才会分配资源。

写代码→GPU

编译代码→CPU

运行测试→CPU

搜索资料→API

这样不同Agent的任务可以共享资源。

实验结果显示,这种调度方式带来明显提升:平均任务时间缩短4.3倍,训练效率提升1.5倍,外部资源成本降低71%,

对于正在进行大规模Agent训练的团队来说,这种效率提升非常关键。

如果把最近几个月的技术动向连起来,会看到一条越来越清晰的路线。

OpenClaw解决的是Agent的运行框架问题,

Claude Code、Devin解决的是Agent在真实任务中的应用问题,

而罗福莉等人做Tangram这样的研究,则开始解决Agent的底层计算问题。

这说明AI行业正在经历一个结构性变化,

竞争的焦点正在从模型能力转向Agent系统能力。

这也正是为什么OpenClaw、Claude Code、Devin会在今年突然变得如此重要。(转载自AI普瑞斯)

扫码下载app 最新资讯实时掌握

扫码下载app 最新资讯实时掌握