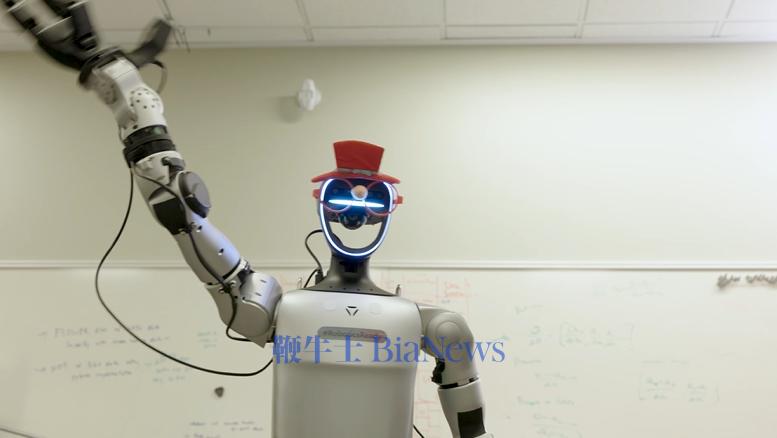

今日,微软正式推出首款源自Phi系列视觉语言模型的机器人模型 ——Rho-alpha(ρα)。微软方面表示,诚邀有意向为自家机器人及应用场景测试该模型的机构,申请加入 Rho-alpha 科研早期访问计划,后续该模型还将通过微软 Foundry 平台对外开放。

据介绍,Rho-alpha 可将自然语言指令转化为控制信号,驱动机器人完成双臂协同操控任务,属于 VLA + 模型范畴。相较于传统 VLA 模型,它突破了感知与学习模态的限制,在感知层面新增了触觉感知功能,目前团队还在研发相关技术以融入力觉等更多感知模态;在学习层面,研发人员正致力于让该模型在实际部署过程中,通过接收人类反馈持续优化性能。

微软方面称,他们希望通过这些技术突破提升物理系统的自适应能力,毕竟自适应能力才是智能的核心标志,而能更好适应动态场景、贴合人类需求的机器人,在生活和工作场景中会更具实用价值。

微软透露,目前团队正针对其及合作方重点关注的双臂操控任务,对 Rho-alpha 的训练流程和训练数据集开展端到端优化,以此提升模型的性能和运行效率。该模型现阶段正在双臂机器人和人形机器人平台上接受测试评估,相关技术细节报告将于未来数月内正式发布。

据悉,Rho-alpha 实现兼具触觉感知与视觉语言理解的操作,得益于一套复合型训练方式,其不仅学习了真实物理场景演示的动作轨迹数据,还融合了模拟任务数据与大规模网络视觉问答数据。微软方面表示,未来将沿用这一技术框架,继续拓展模型的感知模态,使其能够胜任更多现实场景下的任务。

微软方面表示,机器人领域预训练级别的数据本就十分稀缺,尤其是包含触觉反馈等小众感知模态的数据,而仿真技术正是破解这一难题的关键抓手。其基于开源的英伟达 Isaac Sim 仿真框架,采用多阶段强化学习技术生成模拟数据,并将这些模拟动作轨迹与商用及开源的实体演示数据集相融合,构建出完整的训练数据体系。

尽管拓展感知能力能让 Rho-alpha 在运行过程中实时调整动作,但机器人仍有可能出现难以自行修正的失误。对此,操作人员可借助 3D 鼠标这类简易遥操作设备,帮助机器人重新回到正确的操作轨道。

微软方面称,目前正聚焦相关工具开发与模型适配技术,让 Rho-alpha 在实际运行中能够通过接收人类的纠错反馈持续进化。(鞭牛士编译)

扫码下载app 最新资讯实时掌握

扫码下载app 最新资讯实时掌握