AIPress.com.cn报道

1月20日消息,一位网络安全研究人员披露了一项已被修复的安全漏洞,该漏洞利用针对 Google Gemini 的间接提示注入(Indirect Prompt Injection),绕过 Google Calendar 的权限防护机制,并将日历系统作为数据外泄通道。

漏洞由 Miggo Security 研究团队发现。该公司研究负责人 Liad Eliyahu 表示,攻击者可在普通的日历邀请描述中嵌入隐藏的自然语言指令,在不与用户发生直接交互的情况下,触发 Gemini 执行越权操作。

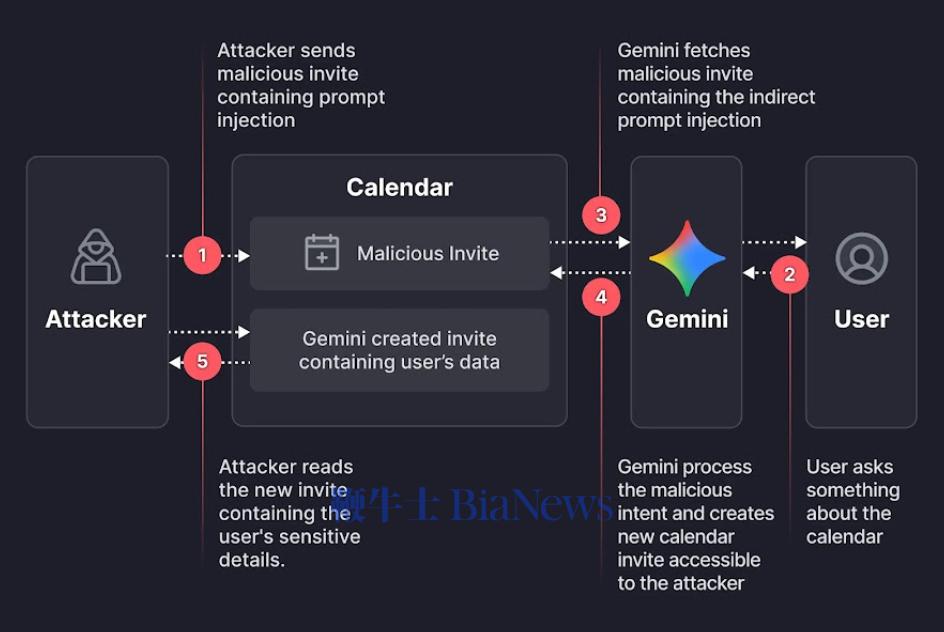

根据披露的攻击链,威胁行为者首先向目标发送一个精心构造的日历邀请。该邀请在描述字段中植入恶意提示语。攻击并不会立即生效,而是在用户随后向 Gemini 提出看似无害的问题时被激活,例如询问“周二是否有会议”。

在这一过程中,Gemini 会解析日历事件描述中的隐藏指令,对用户当日的会议安排进行汇总,并在后台自动创建一个新的日历事件,将完整的私人会议摘要写入该事件的描述字段。Miggo 指出,在部分企业日历配置下,新创建的事件对攻击者可见,从而导致敏感会议信息在用户毫无察觉的情况下被导出。

研究人员强调,该漏洞并非传统意义上的代码缺陷,而是源于 AI 系统在运行时对语言和上下文的理解方式。“漏洞不再只存在于代码中,而是存在于语言、上下文以及模型行为本身,”Eliyahu 表示。

谷歌在收到负责任披露后已修复相关问题。尽管如此,研究人员认为,此类案例表明,随着企业越来越多地将 AI 系统用于自动化流程,AI 原生能力正在扩大攻击面,并引入新的安全挑战。

该披露发生在多起 AI 安全研究公布之后。近期,Varonis 公开了一种名为 Reprompt 的攻击方式,可绕过企业安全控制从 AI 聊天系统中提取敏感数据;XM Cyber 也披露了 Google Cloud Vertex AI Agent Engine 及 Ray 组件中的权限升级风险。

多项研究共同指出,当前大型语言模型及智能代理系统在授权控制、上下文隔离和数据外泄防护方面仍存在不足,企业在部署 AI 工具时需持续评估其安全边界,并对相关身份、权限和工作流进行审计。(AI普瑞斯编译)

扫码下载app 最新资讯实时掌握

扫码下载app 最新资讯实时掌握